Nutbar: ↑

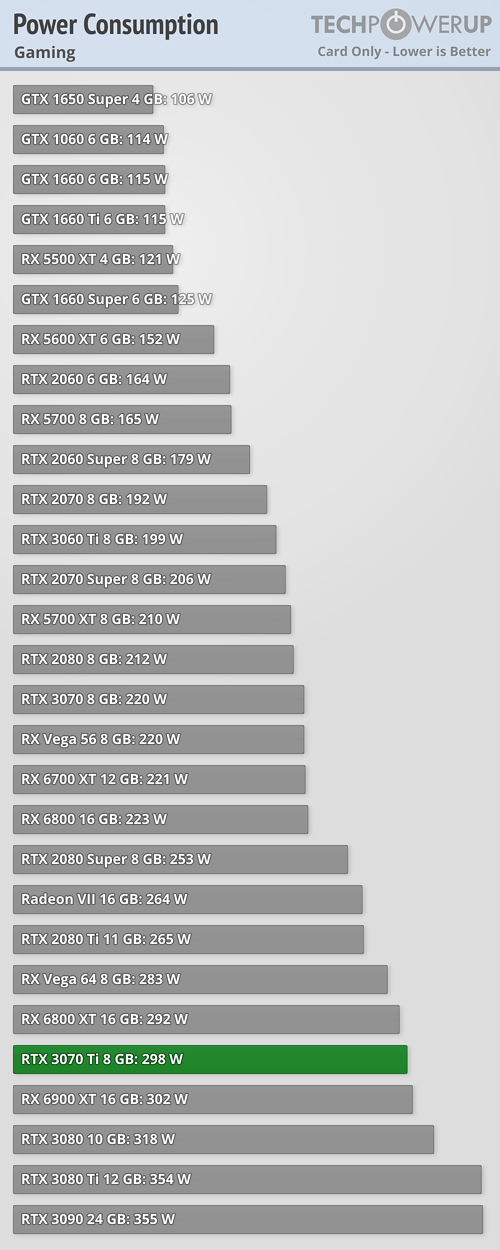

28.10.2021 18:30А ещё 3070Ti паршивая карта, возьмите просто 3070. На 3-5% медленней, но жрёт 220ВТ вместо 300Вт

Прекрасно знаю, что паршивая, я бы однозначно сделал выбор в пользу обычной DDR6, вместо того, чтобы переплачивать за DDR6X, которая греется как сумасшедшая, да ещё и электричества жрёт уйму в придачу. Однако я это написал на основании слухов, что вместе с линейкой Super вроде могут выпустить вариант RTX 3070 Ti с 16 Гб памяти, при том что более предпочтительных для меня 3070 с 16 Гб или ещё лучше 3060 Ti с 16 Гб выпускать не собираются. Видеокарта мне нужна для неторопливых стратегий в 4K и низкий FPS меня не пугает, а то что очень скоро в будущем может возникнуть упор в количество видеопамяти, что просадит производительность капитально - пугает очень сильно. 8 Гб брать ужасно не хочется, поэтому либо 3060 с 12 Гб памяти, либо уже дождаться следующего поколения, где с большой вероятностью объем памяти наконец удвоят для 256-бит моделей и сделают 16 Гб.

Nutbar: ↑

28.10.2021 18:30В крайнем случае разгоните и она даже бодрее окажется на тех же 300Вт (паверлимит на топовых нерефах вполне позволяет).

Я не оверклокер, ничего разгонять 100% не буду, чтоб железо давало малый прирост производительности за счёт огромного прироста в жоре и за счёт более быстрого стощения жизненного ресурса. Наоборот я энергоменеджер по образованию и скорее буду наоборот давить излишне жрущее и переразогнанное с завода железо паверлимитами, так как после того как я привык сидеть на Core 2 Quad + Radeon HD 7750 1 Гб для меня и так всё будет чересчур шустро летать на первых порах как минимум.

Nutbar: ↑

28.10.2021 18:30Стоит БП на 760Вт и абсолютно нормально держит 10700k в разгоне (жор в стресс тестах 150-200Вт, в играх вокруг сотки) и 3080Ti (в играх 350Вт). И так же мелочёвки полно всякой по корпусу раскидано. Не переживайте. Хороший БП сейчас стоит таких копеек по сравнению со всей системой, особенно с видеокартой... Что вы пытаетесь сэкономить?

Ну в общем с учётом, что разгоном я заниматься не буду и 3080Ti для меня слишком жирно и энергозатратно, а такая производительность в неторопливых играх всё равно не нужна, то 750 Вт будет вполне норм для меня вариантом, а за 850 Вт гнаться нет смысла.

Nutbar: ↑

28.10.2021 18:30Возьмите нормальную ходовую модульную модель уже сейчас, а потом докупите проводочек выходящий из БП как 6(+2)+6(+2) и входящий в видеокарту как новый 12. Да и ему год уже этому разъёму, должны быть и БП в стоке под него.

Я так и думал, что годится только модульный блок, чтоб не лепить переходники к уже существующим проводам, а сразу подключать нужный докупленный провод в сам БП.

Nutbar: ↑

28.10.2021 18:30а потом докупите проводочек выходящий из БП как 6(+2)+6(+2) и входящий в видеокарту как новый 12. Да и ему год уже этому разъёму, должны быть и БП в стоке под него.

Я так и не понял, о каком разъеме идёт речь в данной новости. Вроде ж 12 пин разъем, который нВидиа выпустила со своими Ampere Founders Edition в прошлом году, с треском провалился. И он не предусматривал 600 Вт. А 600 Вт вроде бы будет ещё более новый разъем 16 пин (12 пин питания + 4 сигнальных), который впервые появится в 3090 Ti и который будет массово внедрён в будущих видеокартах под PCI-X 5.

Так поддержку какого разъема даст ASUS? Прошлогоднего 12 pin или грядущего 16-pin 600 Вт.

Відправлено через 16 хвилин 36 секунд:

Думаю, что для видеокарт в районе 300 Вт потребления использовать старый модульный БП с новым проводком будет полностью безопасно. Так что возможно если я ориентируюсь на условные RTX 4060/4070 (включая Super/Ti), то можно таки брать обычный БП сейчас и потом его использовать. А вот кто целится в будущем на RTX 4080/4090, то по любому не стоит экономить на мелочах и нужно будет заменить БП на тот, который изначально рассчитан на эти 600 Вт по этим 12 проводкам.

Однако если сегодняшняя RTX 3070 Ti уже жрёт 300 Вт, то условная RTX 4070 Ti уже может вылезти за лимит мощности, на которую рассчитаны нынешние 2x8 пин, следовательно и её опасно будет подключать к нынешним БП.

Кстати уже точно известно, что RTX 4000 серии Lovelace будут на PCI-X 5 версии или могут ещё выйти на PCI-X v.4? Но тогда зачем nVidia спешит с этим единым разъёмом 600 Вт, наверняка под RTX 4000.